🔥 Der Haken: KI ist cool, aber was, wenn sie sich selbst sabotiert? Und warum wird dein Input bald unbezahlbar sein?

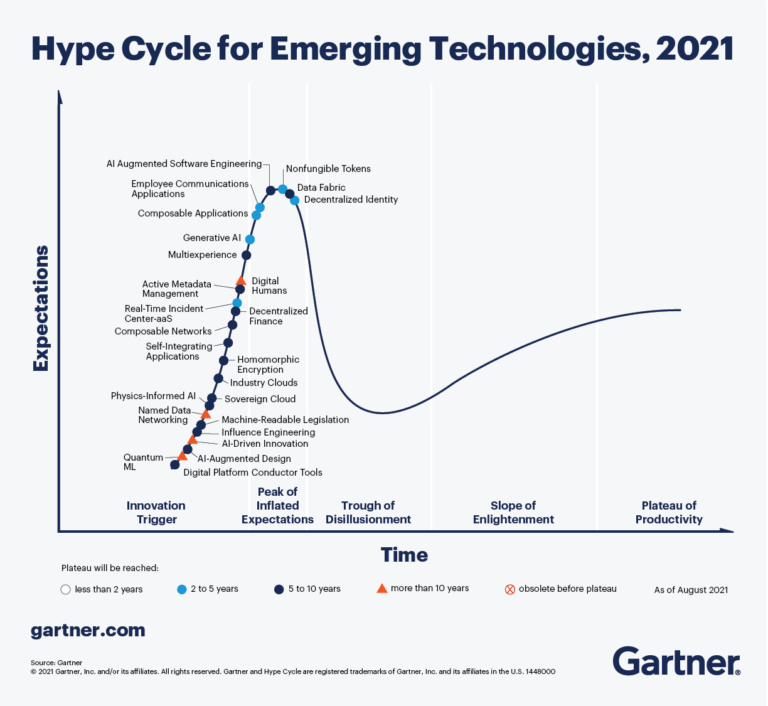

🤖 Generative KI im Aufschwung: KI ist überall, aber sie könnte sich selbst ins Bein schießen, wenn sie auf ihren eigenen Daten trainiert.

🔄 Die KI-Rückkopplungsschleife: „Modellkollaps“ ist das Stichwort. KI, die auf KI trainiert, wird fehleranfällig und verliert den Bezug zur Realität.

🌐 Das Internet wird zum „Blah“: Ein Meer aus nutzlosen Informationen erschwert das Training neuer Modelle und bevorteilt die etablierten Player.

🚫 Soziale Risiken: Diskriminierung und verzerrte Realitäten könnten die dunkle Seite der KI sein.

🌟 Der Wert menschlichen Inputs: In einer Welt, in der KI-Modelle anfällig für Fehler werden, wird menschlich generierter Inhalt zum neuen Goldstandard. Aber wie unterscheiden wir ihn von KI-Inhalten? Die Antwort könnte in der Einführung von „Authentizitäts-Labels“ liegen, die menschlich generierte von KI-generierten Inhalten trennen.

👇 Die KI-Revolution ist faszinierend, aber nicht ohne Fallstricke. Menschlicher Input wird nicht nur überleben, sondern im Wert steigen. Jetzt ist die Zeit, proaktiv zu werden und die Integrität unserer KI-Modelle für eine nachhaltige Zukunft zu schützen.