Wo stehen wir 2026?

2022 konnte ChatGPT nicht zuverlässig rechnen. Heute, vier Jahre später, schreibt GPT-5.3-Codex aktiv an seiner eigenen Weiterentwicklung mit. Claude Opus 4.6 löst Aufgaben, die vor zwei Jahren noch mehrere Tage menschliche Arbeit gebraucht hätten. KI-Systeme lösen heute nicht mehr nur Minuten-Aufgaben, sondern arbeiten stundenlang autonom. Und das in nur 48 Monaten. Die Frage nach LLM-Souveränität war nie drängender als jetzt.

Gartner hat „Sovereign AI“ auf den Peak des Hype Cycle 2025 gesetzt. Das ist kein Zufall. Unternehmen, Regierungen und Organisationen fragen sich alle dasselbe: Wem gehört eigentlich die KI die wir nutzen? Wer hat Zugriff auf unsere Daten? Und was passiert, wenn der Anbieter die Preise verdreifacht oder den Dienst einstellt?

74% aller Unternehmen (laut Gartner KI-Studie 2025) planen in den nächsten zwei Jahren den Einsatz von KI-Agenten. Gleichzeitig beschäftigen sich nur 49% (Bitkom KI-Monitor 2025) überhaupt aktiv mit KI. Da klafft eine Lücke. Und in dieser Lücke liegt das Thema LLM-Souveränität.

Was heisst LLM-Souveränität überhaupt?

LLM-Souveränität bezeichnet die Kontrolle eines Unternehmens darüber, welche Daten in welches KI-Modell fließen, welche Anbieter genutzt werden und welche Ausweichoptionen bestehen. Kurz gesagt: Du entscheidest, wo deine Daten hingehen – und welches Modell du nutzt. Ausserdem hast du einen Plan B, wenn Plan A nicht mehr funktioniert.

Das klingt selbstverständlich. Ist es aber nicht.

Die meisten Unternehmen, die ich berate, haben genau eine KI-Strategie: „Wir nutzen ChatGPT.“ Fertig. Kein Vergleich mit anderen Modellen, keine Fallback-Option, keine Ahnung, was passiert, wenn OpenAI morgen die Preise ändert oder die Nutzungsbedingungen anpasst.

Das ist, wie wenn du dein ganzes Geschäft auf einem einzigen Lieferanten aufbaust. Kein erfahrener Einkäufer würde das machen. Aber bei KI machen es fast alle. LLM-Souveränität bedeutet genau das Gegenteil: Kontrolle zurückgewinnen.

Schritt 1: Mehrere Modelle vergleichen mit LM Council

Andrej Karpathy (ja, der Ex-Tesla-KI-Chef und OpenAI-Mitgründer) hat ein Tool gebaut, das genau dieses Problem löst: LM Council (ein Open-Source-Tool, das eine Frage parallel an mehrere KI-Modelle stellt und die Antworten vergleichen lässt).

Die Idee ist simpel, aber wirkungsvoll. Du stellst eine Frage nicht einem Modell, sondern mehreren gleichzeitig. GPT-5, Claude, Gemini, Llama. Jedes Modell gibt seine Antwort. Dann passiert was Kluges: Die Modelle bewerten sich gegenseitig – wie ein Peer Review in der Wissenschaft. Am Ende fasst ein Moderator-Modell die beste Antwort zusammen.

Warum ist das wichtig?

Weil kein einzelnes Modell bei allem das Beste ist. Claude ist stark bei Analyse und langen Texten. GPT bei kreativem Schreiben und Code. Gemini bei Bild- und Video-Aufgaben. Llama bei spezialisierten Anwendungen. Wenn du nur ein Modell fragst, bekommst du nur eine Perspektive. Und du merkst nicht mal, wenn die Antwort Quatsch ist.

In meinen Keynotes und Workshops zeige ich das live. Dieselbe Frage an verschiedene Modelle. Die Antworten sind teilweise so unterschiedlich, dass die Teilnehmer:innen erstmal schlucken. „Und ich hab mich die ganze Zeit nur auf eins verlassen?“ Genau.

LM Council automatisiert diesen Vergleich. Die Open-Source-Version macht es einfach: Zugangsdaten eintragen, Frage stellen, fertig. Die Ergebnisse kommen mit Bewertungen und Begründungen, warum welche Antwort besser ist.

Für Unternehmen heisst das: Bessere Entscheidungen, weniger Fehler, und ein echtes Verständnis dafür welches Modell für welche Aufgabe taugt.

Das Tool läuft bei mir auf einem Server, man kann es sich aber auch lokal auf seinen Mac installieren. (Wer nicht weiß wie, fragt die KI seines Vertrauens oder mich.)

Schritt 2: Bezahl-LLMs richtig einsetzen

„Warum soll ich für KI bezahlen wenn es ChatGPT kostenlos gibt?“

Diese Frage höre ich in jedem zweiten Gespräch. Und die Antwort ist simpler als man denkt.

Die kostenlose Version von ChatGPT ist wie ein Praktikant, der dir bei allem hilft, aber alles was du ihm sagst auch seinem Chef erzählt. Die Bezahlversion ist wie ein Berater mit Verschwiegenheitspflicht. Und genau hier machen die meisten einen Denkfehler.

20 Euro im Monat für ChatGPT Plus, 100 Euro für Claude Pro oder ein paar Hundert Euro im Monat für die professionelle Nutzung – das klingt nach Kosten. Ist es aber nicht. Es ist der Unterschied zwischen einem veralteten Modell mit gedrosselter Leistung und den neuesten, leistungsstärksten KI-Modellen die es gibt. Die Bezahlversionen geben dir Zugang zu den aktuellsten Modellen, mehr Kapazität pro Anfrage, schnellere Antworten und besseren Datenschutz. Ein Beispiel: Wer über die professionellen Schnittstellen oder einen Business-Plan wie ChatGPT Enterprise arbeitet, dessen Daten werden laut Anbieter nicht zum Training der Modelle verwendet. Bei der kostenlosen Version sieht das anders aus – da können deine Eingaben ins Training einfliessen, je nach Anbieter und Einstellungen. Das ändert sich regelmässig und ist bei jedem Anbieter unterschiedlich geregelt. Das hier ist keine Rechtsberatung – prüft für euren konkreten Fall, welche Datenschutzregeln bei eurem Anbieter gelten und welcher Plan zu euren Anforderungen passt.

Stell dir vor, du lässt einen Anwalt deine Verträge prüfen. Würdest du den günstigsten nehmen, der nebenbei alles an die Gegenpartei weitergibt? Natürlich nicht. Bei KI ist es dasselbe. Die paar Euro im Monat sind keine Kosten – sie sind eine Investition in Qualität und Kontrolle.

Warum Kontrolle wichtiger ist als Kosten

Denn es geht um noch mehr als Geld und Datenschutz.

Bezahlte Zugänge geben dir Kontrolle. Du bestimmst, wie kreativ das Modell antwortet. Du gibst ihm Kontext über dein Unternehmen. Du baust Abläufe, die auf deine Prozesse zugeschnitten sind. Mit der kostenlosen Version geht das nicht.

Und dann die Zuverlässigkeit. Wer schon mal versucht hat, ein Geschäftsmodell auf der kostenlosen Version aufzubauen, weiss, wovon ich rede. Ausfälle, Einschränkungen, Modellwechsel ohne Vorwarnung. Mit einem professionellen Vertrag hast du Garantien, Support und planbare Kosten.

Mein Rat: Fang mit einem Bezahl-Account bei zwei bis drei Anbietern an. Bei CTRL+ALT+LEAD helfe ich Mittelständlern genau dabei. OpenAI, Anthropic und Google bieten alle Business-Pläne. Die Kosten sind überschaubar und du gewinnst Unabhängigkeit.

Schritt 3: Lokale KI für echte LLM-Souveränität

Jetzt wird’s richtig interessant.

Alles, was ich bisher beschrieben hab, nutzt die Cloud. Deine Daten verlassen dein Unternehmen, auch wenn die Anbieter versprechen, sie nicht fürs Training zu verwenden. Für manche Anwendungen ist das okay. Für andere nicht.

Ein Maschinenbauer aus Stuttgart mit 200 Leuten, der seine Konstruktionszeichnungen durch eine KI jagen will? Der will nicht, dass die bei irgendeinem US-Cloudanbieter landen. Ein Anwalt, der Mandantenakten analysiert? Gleiche Geschichte.

Die Lösung: KI-Modelle, die komplett auf deiner eigenen Hardware laufen. Kein Internet nötig, keine Cloud, keine Daten, die irgendwohin fliessen.

Und das Verrückte ist: Das geht heute auf einem normalen Rechner.

Was du brauchst

Einen Computer. Klappt auf deinem Laptop – besser wäre natürlich ein aktueller Mac Mini mit viel Arbeitsspeicher (64 GB empfohlen). Auf Windows- und Linux-Rechnern funktioniert es genauso, idealerweise mit einer guten Grafikkarte.

An Software brauchst du eine von drei Optionen:

Ollama ist der einfachste Einstieg. Open Source, läuft auf allen Plattformen und unterstützt dutzende Modelle – von Llama 3.3 über Mistral bis DeepSeek.

Ollama installieren – egal welches Betriebssystem

Die Installation ist auf allen Systemen simpel. Auf dem Mac lädst du die App von ollama.com herunter oder installierst per Homebrew. Auf Windows gibt es einen Installer zum Durchklicken. Auf Linux reicht ein einziger Befehl im Terminal. In allen Fällen dauert es wenige Minuten – und danach bist du startklar.

Nach der Installation tippst du im Terminal oder in der Kommandozeile einen kurzen Befehl, und schon lädt Ollama das gewünschte Modell herunter. Ab da läuft alles lokal auf deinem Rechner. Auf dem Mac nutzt Ollama automatisch die eingebaute Grafikbeschleunigung von Apple Silicon – du musst nichts konfigurieren. Auf Windows und Linux wird eine vorhandene Grafikkarte ebenfalls automatisch erkannt.

Das Schöne daran: Ollama stellt automatisch eine Schnittstelle bereit, über die andere Programme dein lokales Modell nutzen können – ob Automatisierungstool, eigene App oder ein einfaches Script. Keine laufenden Kosten, keine Daten die dein Netzwerk verlassen.

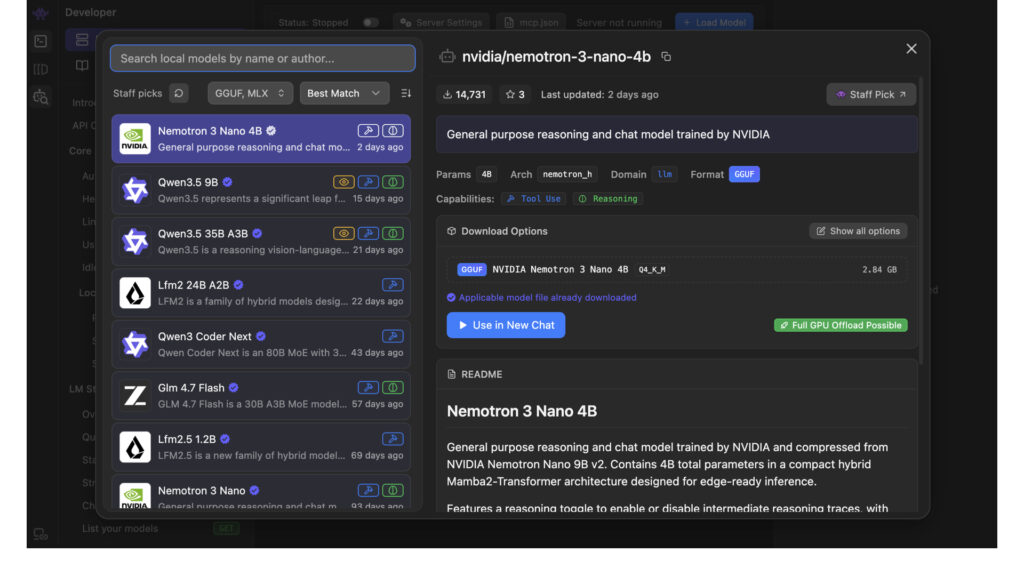

LM Studio: KI lokal mit grafischer Oberfläche

LM Studio ist für alle, die kein Terminal mögen, der beste Einstieg. Du bekommst eine grafische Oberfläche, die sich anfühlt wie ChatGPT – nur dass alles auf deinem Rechner läuft. Kein Account, keine Cloud, keine Daten die dein Netzwerk verlassen.

Die Installation ist simpel: App von lmstudio.ai herunterladen, starten, Modell aus dem Katalog auswählen – und loschatten. LM Studio erkennt automatisch, was dein Rechner kann, und nutzt die vorhandene Hardware optimal aus.

Besonders praktisch für Unternehmen: LM Studio kann auf Knopfdruck einen lokalen Server starten, der genauso funktioniert wie die Schnittstelle von ChatGPT. Das heisst, jedes Tool, das mit ChatGPT funktioniert – ob Automatisierung, eigene App oder Workflow – funktioniert auch mit deinem lokalen Modell. Du änderst nur eine Einstellung. Deine bestehende Infrastruktur bleibt, aber die Daten bleiben auf deinem Rechner.

LM Studio unterstützt dutzende Modelle: Llama 3.3, Mistral, Phi-4, Qwen 2.5, DeepSeek und viele mehr. Du kannst mehrere Modelle gleichzeitig geladen haben und zwischen ihnen wechseln – ideal zum Vergleichen.

Ein aktueller Mac Mini mit 64 GB Arbeitsspeicher kann Modelle laufen lassen, die in vielen Bereichen an die Qualität von GPT-4 herankommen. Für Zusammenfassungen, Analysen und Textarbeit absolut brauchbar. Modelle wie Phi-4 von Microsoft oder Mixtral von Mistral sind überraschend gut für ihre Grösse und laufen flüssig auf aktueller Consumer-Hardware.

OpenRouter: Ein Zugang, alle Modelle

OpenRouter gibt dir über einen einzigen Zugang die Möglichkeit, über 300 KI-Modelle zu nutzen – von Claude über GPT-5 bis hin zu Open-Source-Modellen wie Llama und Mistral. Ein Account, eine Rechnung, alle Modelle.

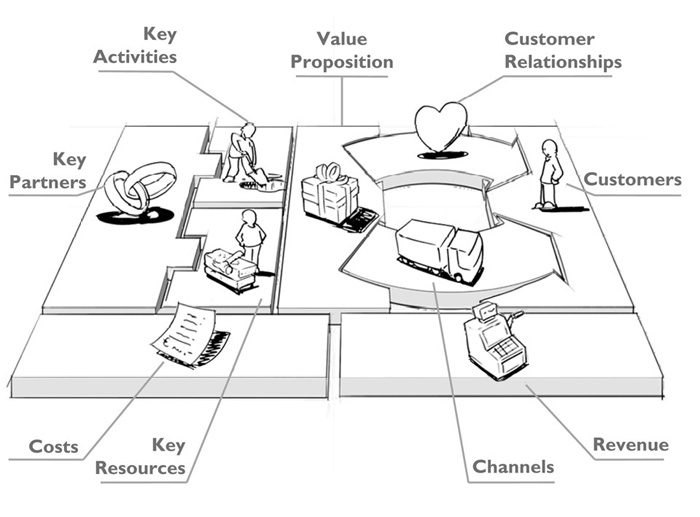

Wie funktioniert das Geschäftsmodell?

Viele Leute verstehen noch nicht, dass du nicht bei jedem KI-Anbieter einen eigenen Account brauchst. Du musst dich nicht einzeln bei OpenAI, Anthropic, Google, Meta und Mistral registrieren, überall Kreditkarten hinterlegen und verschiedene Zugänge verwalten. Es gibt Vermittler wie OpenRouter, die genau dieses Problem lösen.

Das Prinzip ist simpel: OpenRouter hat selbst Verträge mit allen grossen KI-Anbietern. Wenn du über OpenRouter eine Anfrage an Claude schickst, leitet OpenRouter diese weiter, bekommt die Antwort und reicht sie an dich durch. Du zahlst pro Nutzung – und OpenRouter nimmt einen kleinen Aufschlag als Marge. Sie sind im Grunde Grosshändler, die zwischen Hersteller und Endkunde sitzen.

Der Aufschlag liegt typischerweise bei 5-20% auf den Originalpreis. Dafür bekommst du: einen einzigen Account, eine einzige Rechnung, Zugang zu allen Modellen, automatisches Umschalten wenn ein Anbieter ausfällt, und Preisvergleiche in Echtzeit. Ob sich das lohnt, hängt vom Volumen ab – bei normaler Nutzung ist der Aufschlag vernachlässigbar, bei Massenverarbeitung rechnest du besser mit Direktverträgen.

Für den Einstieg und für den Mittelstand ist das Modell ideal: Du testest verschiedene KI-Modelle ohne langfristige Verpflichtung, zahlst nur was du nutzt, und wechselst das Modell mit einem Klick. Kein Vendor-Lock-in, keine Mindestverträge.

Der realistische Vergleich

Ich will hier ehrlich sein: Ein lokales Modell auf dem Mac Mini ist nicht so gut wie Claude Opus 4.6 oder GPT-5 in der Cloud. Nicht bei komplexen Analysen, nicht bei kreativem Schreiben, nicht bei grossen Coding-Projekten.

Aber es ist gut genug für 70-80% der täglichen KI-Aufgaben in einem Unternehmen. E-Mails zusammenfassen, Dokumente analysieren, Berichte erstellen, einfache Übersetzungen, Datenbankabfragen in natürlicher Sprache.

Und der entscheidende Punkt für deine LLM-Souveränität: Deine Daten bleiben bei dir. Komplett. Immer. Ohne Ausnahme.

Die Hybrid-Strategie für LLM-Souveränität

Nach über hundert Beratungsgesprächen als digitaler Beirat empfehle ich eine Drei-Stufen-Strategie:

Stufe 1: Lokale KI für sensible Daten. Alles, was Kundendaten, Verträge, Finanzzahlen oder Geschäftsgeheimnisse enthält, geht über das lokale Modell. Mac Mini ins Büro, Ollama oder LM Studio drauf, fertig. Das ist LLM-Souveränität in der Praxis. Die Qualität reicht für 80% der Anwendungsfälle.

Stufe 2: Bezahlte Cloud-Dienste für komplexe Aufgaben. Wenn du die beste Antwortqualität brauchst (komplexe Analyse, Code, Strategie-Dokumente), nutzt du Claude oder GPT über einen professionellen Zugang. Mit Datenschutzverträgen und Garantien.

Stufe 3: LM Council für wichtige Entscheidungen. Bei Fragen, wo es wirklich drauf ankommt, schickst du die Anfrage an mehrere Modelle und lässt sie sich gegenseitig prüfen. Das dauert länger und kostet mehr, aber die Ergebnisqualität ist nochmal eine andere Liga.

Kein Unternehmen braucht für alles die teuerste Cloud-KI. Und kein Unternehmen sollte für alles nur ein lokales Modell nutzen. Die Mischung macht’s.

Und jetzt?

LLM-Souveränität ist kein Nice-to-have mehr. Es ist eine strategische Entscheidung, die du heute treffen solltest. Nicht nächstes Quartal. Nicht wenn „die IT-Abteilung sich drum kümmert.“

Du brauchst kein Riesenbudget und kein KI-Team. Du brauchst einen aktuellen Rechner, zwei professionelle KI-Zugänge und eine klare Entscheidung, welche Daten wohin dürfen.

Ich sage immer: Es geht nicht darum, ob KI kommt. Es geht darum, ob du entscheidest oder ersetzt wirst.

Bei der LLM-Souveränität ist es genauso. Es geht nicht darum, ob du KI nutzt. Es geht darum, ob du die Kontrolle behältst.

Weiterlesen: Warum die Kontrolle über KI auch eine rechtliche Pflicht ist, zeigt der Beitrag zur Sorgfaltspflicht im Aufsichtsrat. Was passiert, wenn KI-Sicherheit versagt, beschreibt der McKinsey-Hack. Und wie Unternehmen das Gleichgewicht zwischen Sicherheit und Geschwindigkeit finden, ist eine der zentralen Fragen der KI-Strategie.